阿里巴巴最新开源模型 Qwen3 正式发布!想要在自己的电脑上跑起来,又担心云端成本和隐私安全?

本文将手把手带你通过 Ollama + Open WebUI 实现 Qwen3 的本地私有化部署,并利用 贝锐花生壳内网穿透 技术,打破局域网限制,让你随时随地、安全地调取家中的 AI 大模型!

🚀 第一阶段:Ollama 一键开启 Qwen3 本地部署

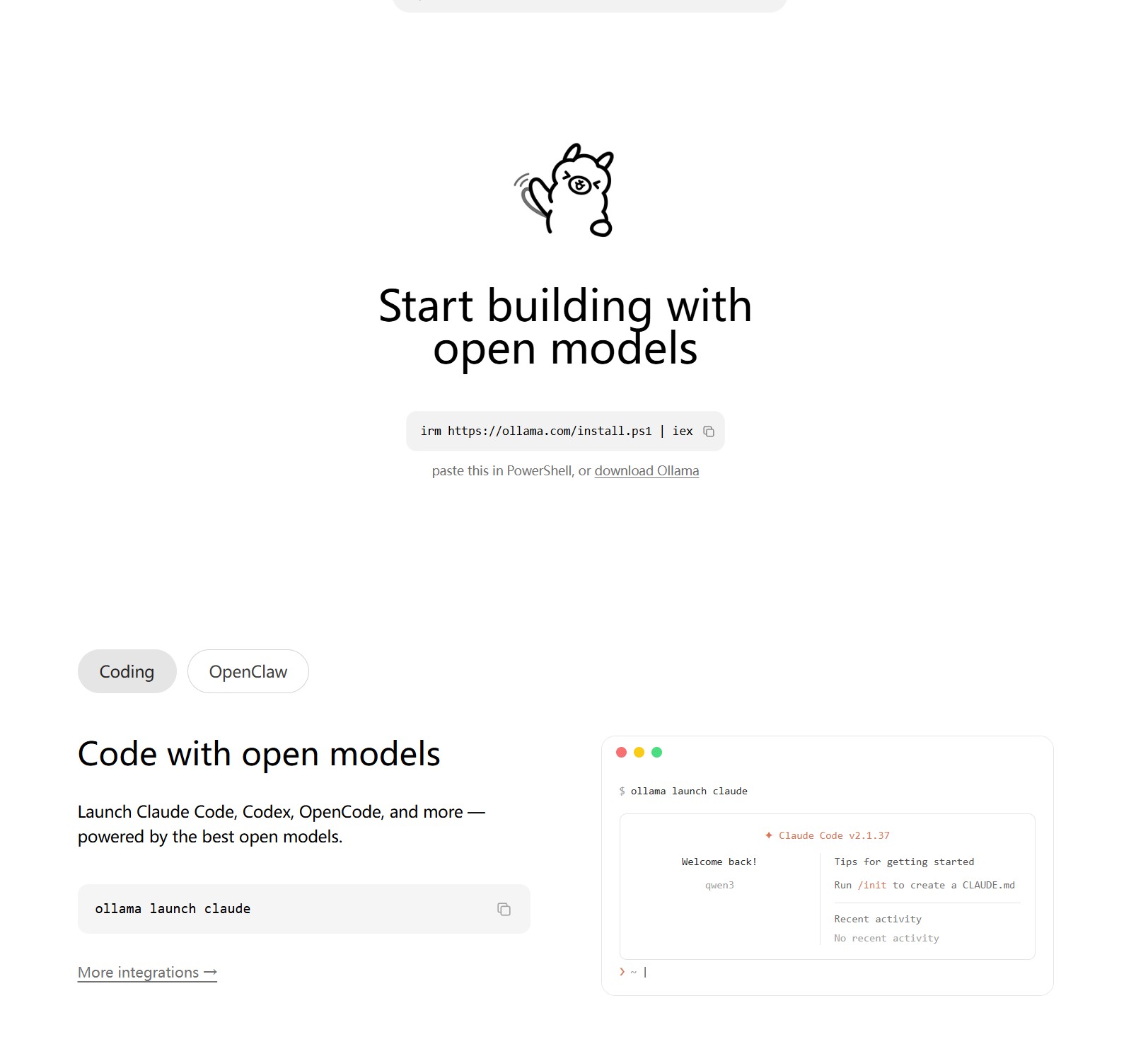

Ollama 是目前最流行的本地 AI 运行框架,能够极大地简化部署流程。

1. 安装 Ollama

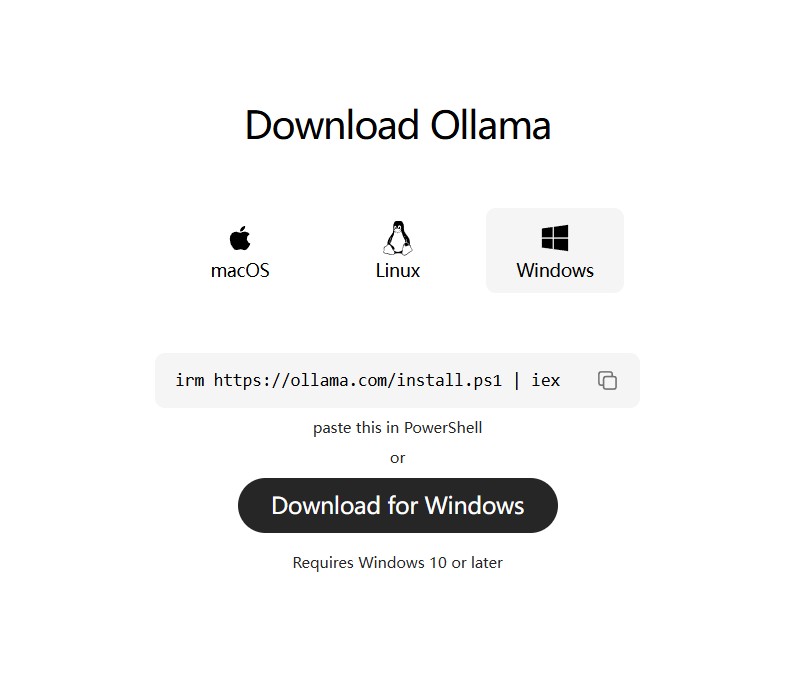

访问 Ollama 官网,下载并安装对应系统的客户端。

2. 下载并运行 Qwen3

打开终端(Command Prompt 或 PowerShell),输入以下命令:

Bash

ollama run qwen3:8b

💡 显存避坑指南: 请根据你的显卡配置选择合适的模型参数版本:

4G 显存: 推荐使用

1.5B版本8G 显存: 推荐使用

7B/8B版本16G 及以上: 可挑战

14B或更高版本

🎨 第二阶段:图形化交互,部署 Open WebUI

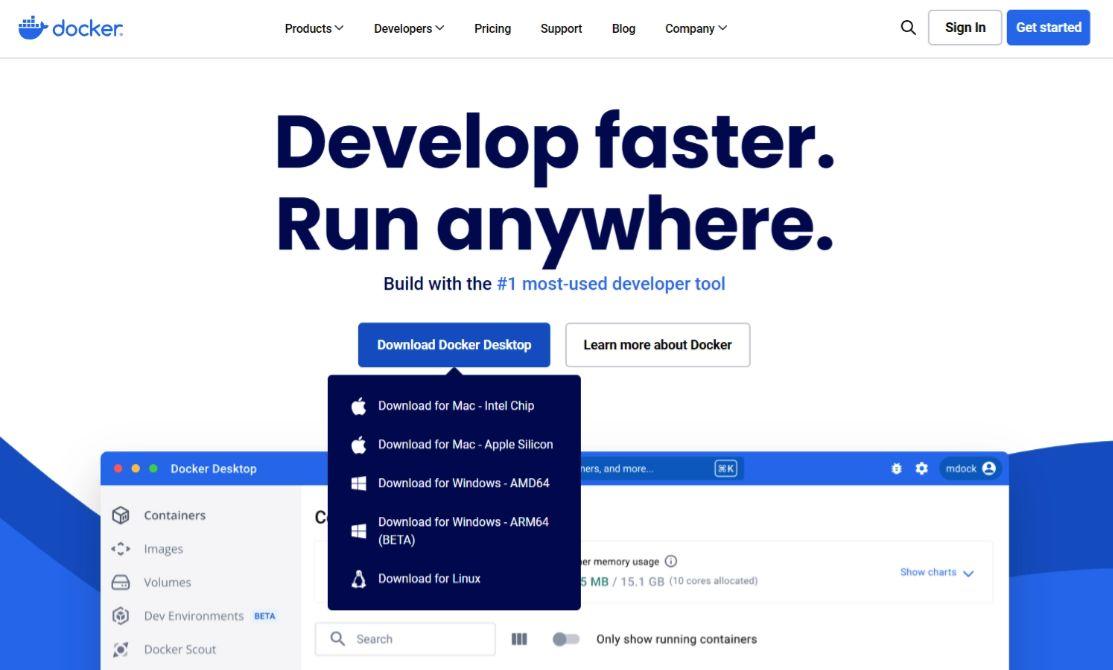

命令行太硬核?我们通过 Docker 部署 Open WebUI,为你提供媲美 ChatGPT 的丝滑交互界面。

1. 准备环境

确保电脑已安装并运行 Docker。若未安装,请前往 Docker 官网下载。

2. 执行部署命令

在终端输入以下指令,一键搭建 Web 界面:

Bash

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always

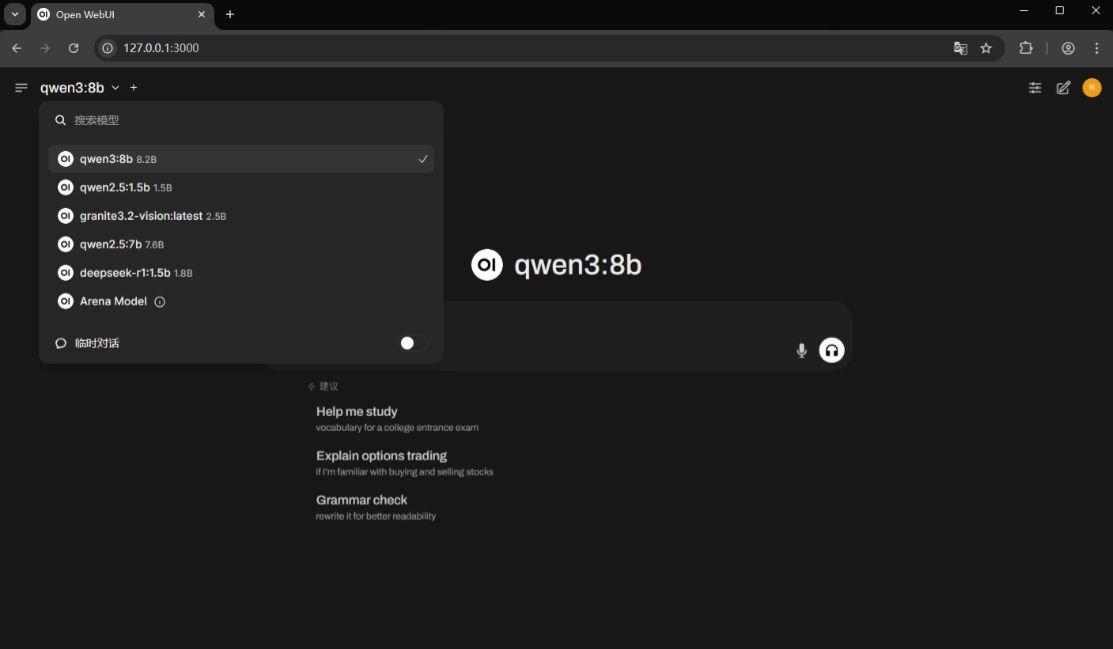

3. 访问与初始化

部署完成后,在浏览器输入 127.0.0.1:3000。首次登录需设置管理员账号,随后即可在下拉菜单中选择 Qwen3 开始对话!

🌐 第三阶段:贝锐花生壳赋能,实现安全远程访问

本地部署虽好,但出门在外想用怎么办?传统的端口映射操作复杂且不安全。贝锐花生壳内网穿透 提供了一种无需公网 IP、加密传输的完美解决方案。

1. 登录客户端

注册并登录 贝锐花生壳 客户端。

2. 配置映射规则

进入花生壳管理后台,添加映射:

应用名称: 我的私有 Qwen3

内网主机: 127.0.0.1(或你的局域网 IP)

内网端口: 3000

安全保障: 建议开启 HTTPS 加密传输,并设置 访问密码。

3. 一键生成外网地址

点击保存后,花生壳会自动生成一个专属的 外网访问地址。现在,无论是在咖啡馆还是办公室,只要有网络,你就能安全地访问家中的 AI 模型。

🛡️ 为什么选择贝锐花生壳保障 AI 安全?

将 AI 服务暴露在公网存在被攻击的风险。贝锐花生壳通过以下高级功能,为你的本地 AI 筑起“防火墙”:

精细化访问控制: 支持基于时间段、IP 区域、浏览器版本进行授权。

双重防护: HTTPS 高强度加密 + 网页访问密码,防止非法入侵。

爆破防护: 自动拦截恶意扫描,确保 AI 资源不被滥用。

总结

通过上述步骤,我们不仅成功实现了 Qwen3 的私有化落地,还借助 贝锐花生壳 解决了“远程访问”这一痛点。无需昂贵的云服务器,无需复杂的网络设置,一个安全、高效、专属的 AI 助手就这样诞生了!

你想尝试部署哪个规模的 Qwen3?在操作过程中遇到任何疑问,欢迎在评论区留言讨论!

评论区